12月23日、Dreamtonics株式会社が開発し、株式会社AHSが販売をする歌声合成ソフト、Synthesizer Vがバージョンアップし、より強力な機能、性能を備えたソフトへと進化しました。バージョンはこれまでの1.4.1から1.5.0と数字的には0.1上がっただけのマイナーバージョンアップに見えるし、既存ユーザーはすべて無料アップデートできるので、大したことがないもののように見えますが、まさにメジャーバージョンアップといって間違いない飛躍を果たしています。もはや人間の歌声との区別がつかないレベルにまで進化しているとともに、中国語や英語の歌声データベースに日本語を歌わせることができるようになったり、反対に小春六花や弦巻マキの日本語データベースを使いながら英語や中国語を歌わせるといったことも可能になったのです。

一方、本日付けで新たなSynthesizer Vの歌声データベースとして「京町セイカ」がリリースされました。こちらは、声優の立花理香さんの声を元に制作した、中域のふくよかさと高域にかけてのシャープさをあわせ持ち、素直でストレートな歌唱を得意とする歌声データベースとのこと。従来からのスタンダード版に加え、よりリアルな歌声を追求したAI版の2つの商用利用可能な歌声データベースとなっています。そこで、ここでは主にSyntheizer Vがどのように進化しているのか、実際の歌声も交えて紹介してみたいと思います。

1.5.0へのバージョンアップで飛躍的な性能向上を果たしたSynthesizer V

1.5.0へのバージョンアップで飛躍的な性能向上を果たしたSynthesizer V

驚異的に進化したSynthesizer V AI

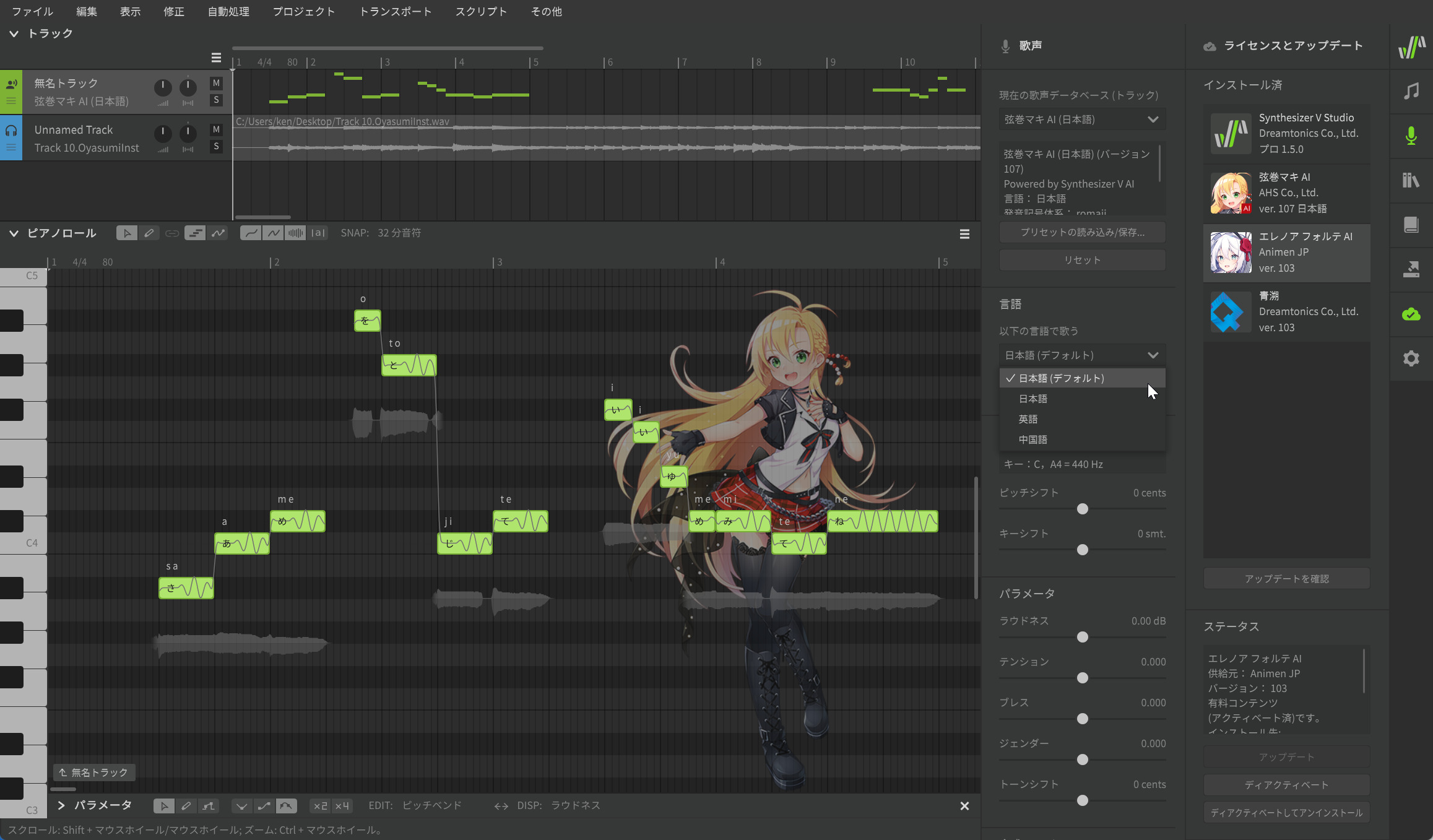

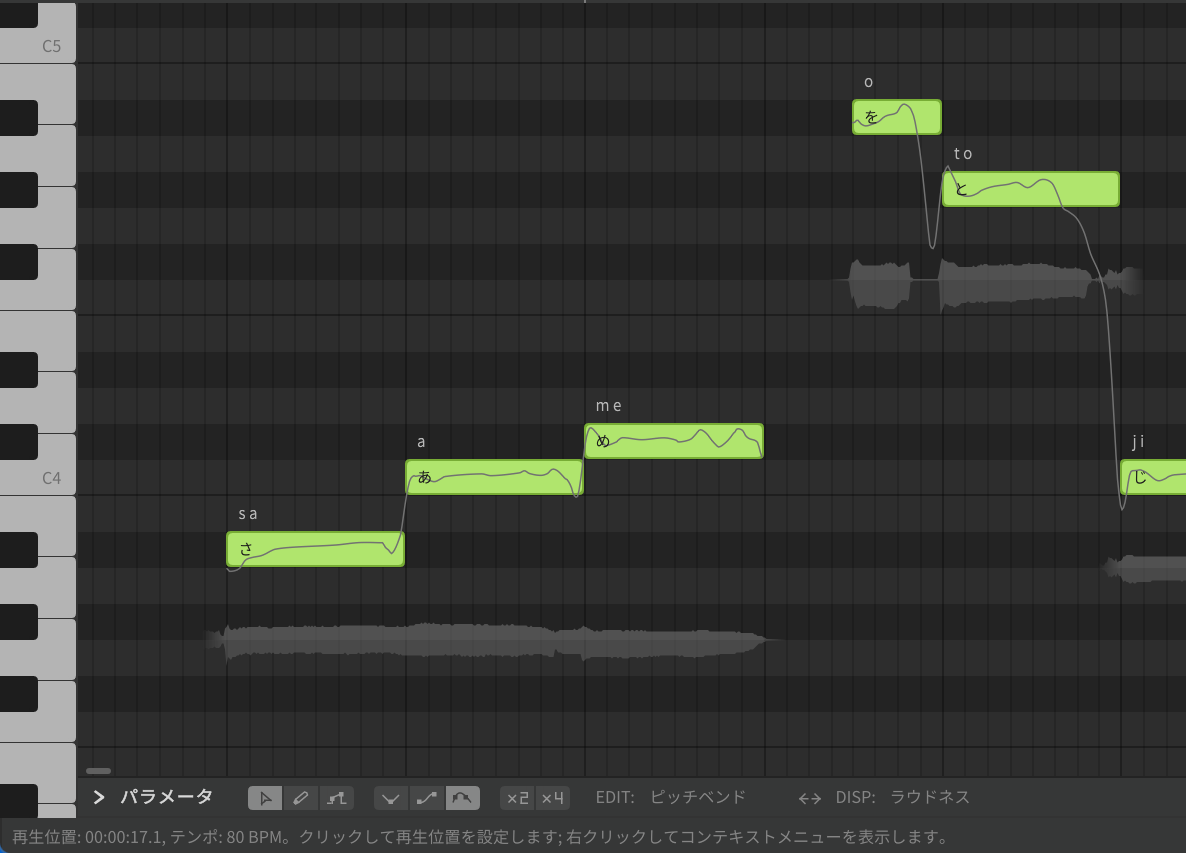

まずは、バックグラウンドや機能、性能といったものを紹介する前に、私がSynthesizer V Pro Studioの1.5.0を使って打ち込んだ、弦巻マキの歌声をちょっと聴いてみてください。

いかがですか?従来の歌声合成の概念を覆すレベルに来ていると思いませんか?これは、2年前のコミケでDTMステーションCreativeからリリースしたoyasumiという曲の冒頭部分。そのときは声優の小岩井ことりさんにボーカルをお願いし、囁くように優しく歌ってもらったので、弦巻マキにも、それっぽく歌わせて仕上げてみたのです。本来、弦巻マキは「アニメキャラっぽい雰囲気の元気な女の子」というイメージの歌声ですが、そことはだいぶ違ったニュアンスの歌声になっているのも感じられたと思います。

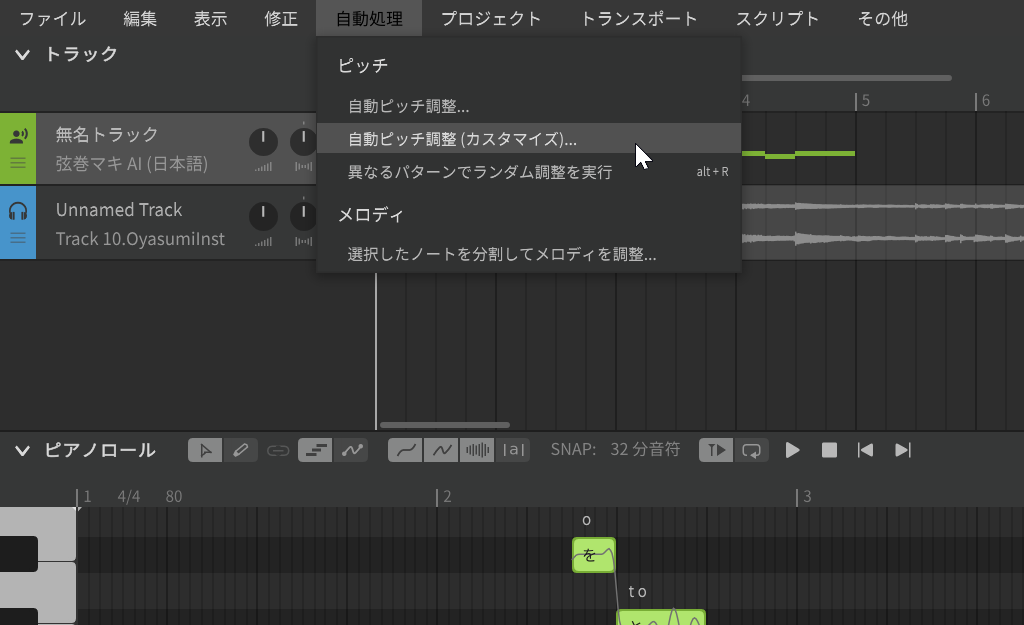

「自動処理」メニューにある「自動ピッチ調整(カスタマイズ)」を選択する

「自動処理」メニューにある「自動ピッチ調整(カスタマイズ)」を選択する

自動ピッチ処理(カスタマイズ)がポイント

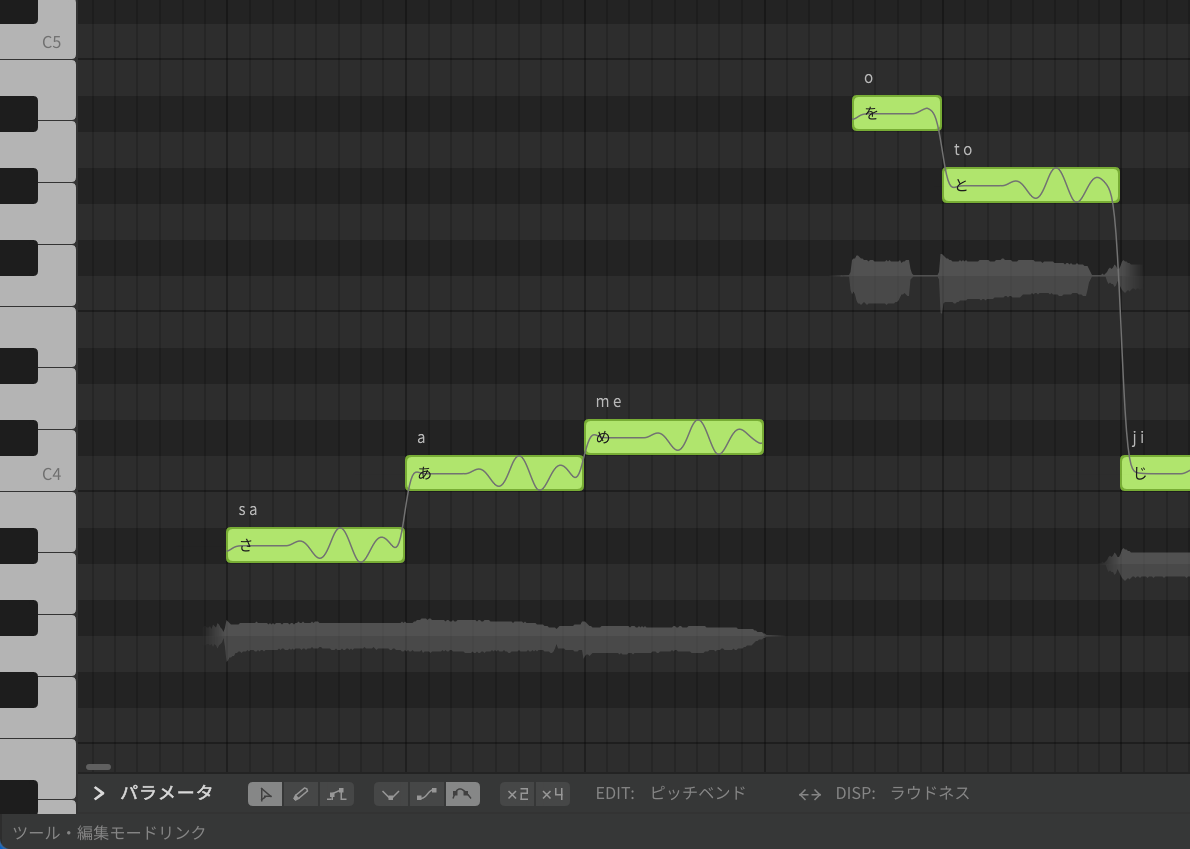

上記YouTubeではSynthesizer V Studio Proの画面を表示させていますが、リバーブがかかっていることからもわかる通りで、単なるベタ打ちをそのままというわけではなく、ちょっぴりだけ加工しています。具体的にはまずベタ打ちで音符と歌詞を入力した後、「自動ピッチ処理(カスタマイズ)」というオマジナイのようなコマンドを実行して、まるで人間のような歌声へと進化させました。パラメーターはいくつかありますが、ここでは自由度を少し上げただけで、ほかはデフォルトのまま。ここをいじると、さらに雰囲気は変わってくるようです。

声の揺らぎ、ビブラート、しゃくり、などのパラメーターがあるがここでは何も変えず、自由度だけ少し上げてみた

声の揺らぎ、ビブラート、しゃくり、などのパラメーターがあるがここでは何も変えず、自由度だけ少し上げてみた

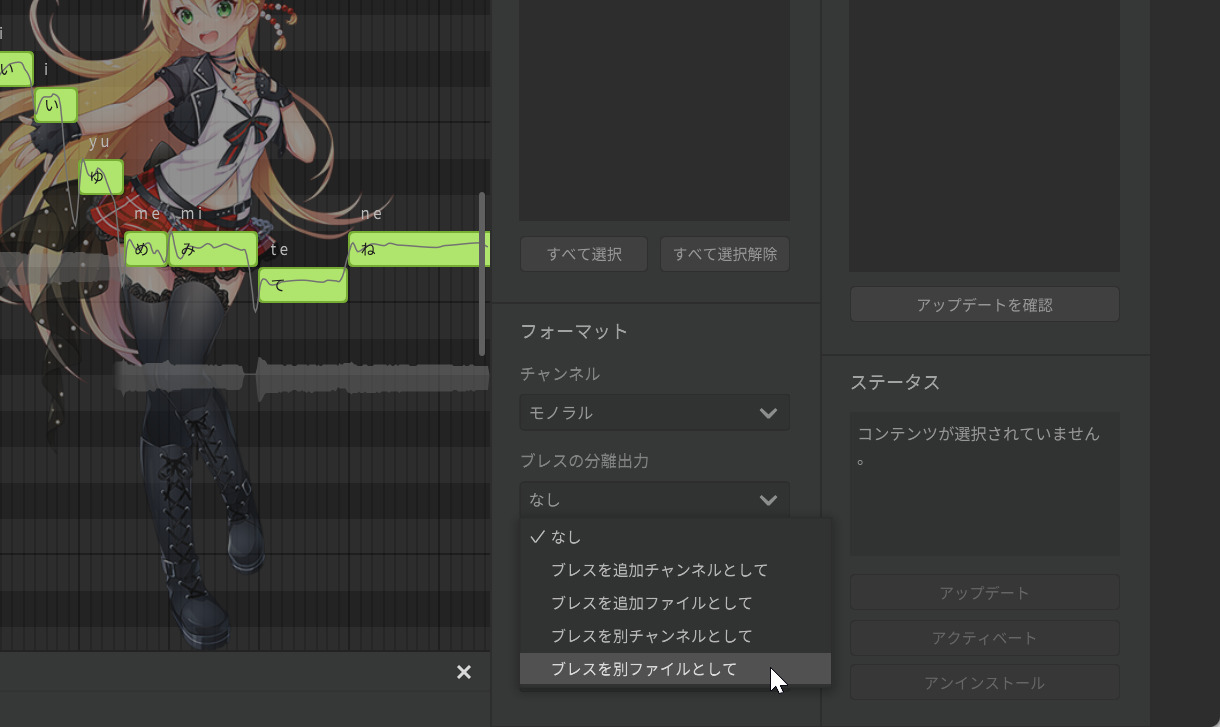

その後、Synthesizer Vのレンダリング機能を用いて歌声をWAVで書き出してDAWへ持っていったのですが、その際に「ブレスの分離出力」という機能を使って有声音のWAVと無声音のWAVの2種類に分けて出力して持って行った上で、無声音のバランスを強めにして、少しハスキーな囁き声にしています。

レンダリングしてWAVファイルを書き出す際、ブレス成分(無声音)を分離させて別ファイルとしてみた

レンダリングしてWAVファイルを書き出す際、ブレス成分(無声音)を分離させて別ファイルとしてみた

そして少しボーカルにリバーブをかけたという感じで、本当にごく簡単な処理をしただけ。昔の歌声合成における調声、といった細かな作業はしてないので、ベタ打ち後に数ステップの手順を踏んだだけなんです。

ちなみに単なるベタ打ちでリバーブ処理だけをしたのがこちらです。

AIを用いたSynthesizer Vの歌声合成エンジン、すでに第4世代だか、第5世代?になっているので、弦巻マキのベタ打ちでの歌い方もかなり進化してはいるのですが、まだ若干、合成っぽさがあるかなと個人的には感じました。ここに自動ピッチ調整をかけるだけで、本当に人間的になるんですよね。

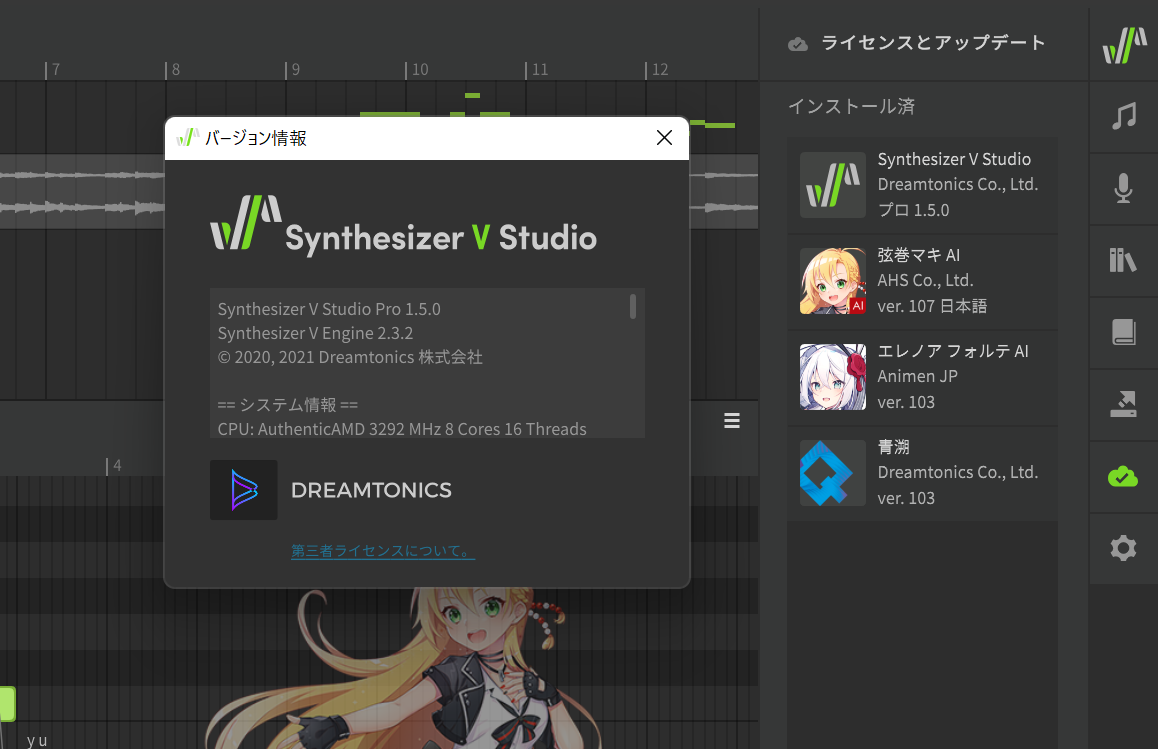

エディタであるSynthesizer V Studio Proは1.5.0、エンジンは2.3.2と表示されている

エディタであるSynthesizer V Studio Proは1.5.0、エンジンは2.3.2と表示されている

これまで何度か記事で取り上げてきたこともあるし、「歌声合成ソフトウェア SynthesizerVユーザーズガイド」というガイドブックも出しているので、ご存じの方も多いと思いますが、一言でSynthesizer Vといってもその中にはスタンダードのエンジンとAIエンジンの2つが搭載されており、どちらの歌声データベースを使うかによってエンジンが切り替わり、歌声も大きく変わってきます。

筆者が書いたSynthesizer Vの使い方の解説書、「歌声合成ソフトウェア SynthesizerVユーザーズガイド」

筆者が書いたSynthesizer Vの使い方の解説書、「歌声合成ソフトウェア SynthesizerVユーザーズガイド」

2020年7月に発売されたSynthesizer V、当初はスタンダードのエンジンのみのスタンドアロン版でしたが、その後「新世代歌声合成ソフトSynthesizer V Studio ProがアップデートしVST3/AUに対応」という記事で紹介した通りプラグインとしても使えるようになったり、「AI歌声合成に対応したSynthesizer V AIがいよいよリリース。既存ユーザーは無料アップグレード可能。併せてAHSが各種新情報を一挙公開」という記事で紹介したように、AIエンジンを搭載したハイブリッド仕様になったり……とメジャーバージョンアップに匹敵する機能、性能強化を繰り返し、今年11月にリリースした1.4では第4世代となっていたんですね。

人間は複数回歌うと必ず毎回違う、これが人間らしさのカギ!?

今回Dreamtonicsでは第5世代とは言ってはいないものの、実際エンジンは大きく向上しているため、より滑らかに歌い、多言語対応も実現しているんですね。ちなみに、自動ピッチ処理自体は初期から標準実装されていました。が、先ほどのオマジナイといった「自動ピッチ処理(カスタマイズ)」という機能、あまり声高に叫ばれていなかったので、私もよく理解していなかったのですが、1.3.xの第3世代で自動ピッチ処理をより強化する形で搭載されており、かなり人間的に歌うようにはなっていたのです。ただ、その人間っぽさが1.5.0でさらにグッと上がったというわけですね。

前述の自動ピッチ調整をした結果の波形。ややピッチの揺れが和らいでいる!?

前述の自動ピッチ調整をした結果の波形。ややピッチの揺れが和らいでいる!?

自動ピッチ処理という名前からもわかるとおり、ピッチの動きを自動で行ってくれる機能で、いわゆる調声をAIを使って行っているのです。先ほどのメニューでお気づきの方もいると思いますが「自動ピッチ調整」と「自動ピッチ調整(カスタマイズ)」の2種類がありますが、前者はAI版のみとなり、まさに人間的な歌い方にしてくれるのですが、キャラクタの歌い方の雰囲気をかなり残しつつピッチ調整する方法です。それに対し、後者はより多くの人の歌い方を深層学習した結果を当てはめているのだとか。つまり、弦巻マキであれば、その中の人である声優の田中真奈美さんの歌い方ソックリにするのが前者で、声質は残しつつ、いろいろな人のうまい歌い方を適用するのが後者なんです。そのため後者の「自動ピッチ調整(カスタマイズ)」に関してはスタンダード版でも利用できるようになっています。

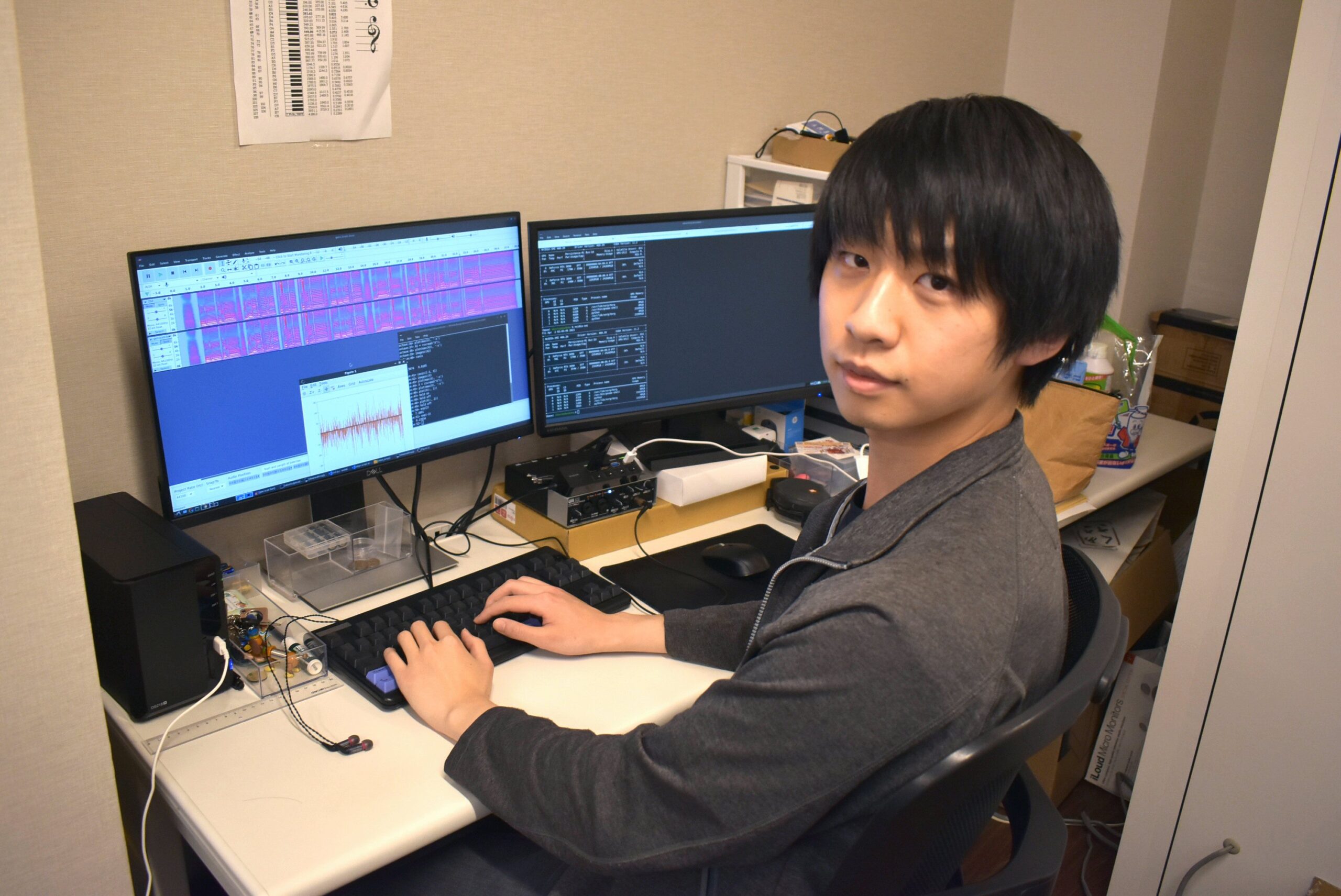

Synthesizer Vの開発者であり、Dreamtonics株式会社の代表取締役であるKanru Huaさん

Synthesizer Vの開発者であり、Dreamtonics株式会社の代表取締役であるKanru Huaさん

何をしているのか、開発者であるKanru Huaさんにメッセンジャーを使って聞いてみたところ、以下のような返事が返ってきました。

今まで製品化されている歌声合成技術は、一つの曲に対して正確な歌い方は一つしかないと想定していました。しかし、人間は同じ曲を何回歌ったら、必ず違いが出ます。アルゴリズムにとって、複数の正確な答えがある時、その全部の平均になりがちです。そうなると、音がこもります。1.3.0以来、「正しい歌い方は一つ以上にある」を認識しながらモデルを作りました。1.5.0はさらにに改善ができました。

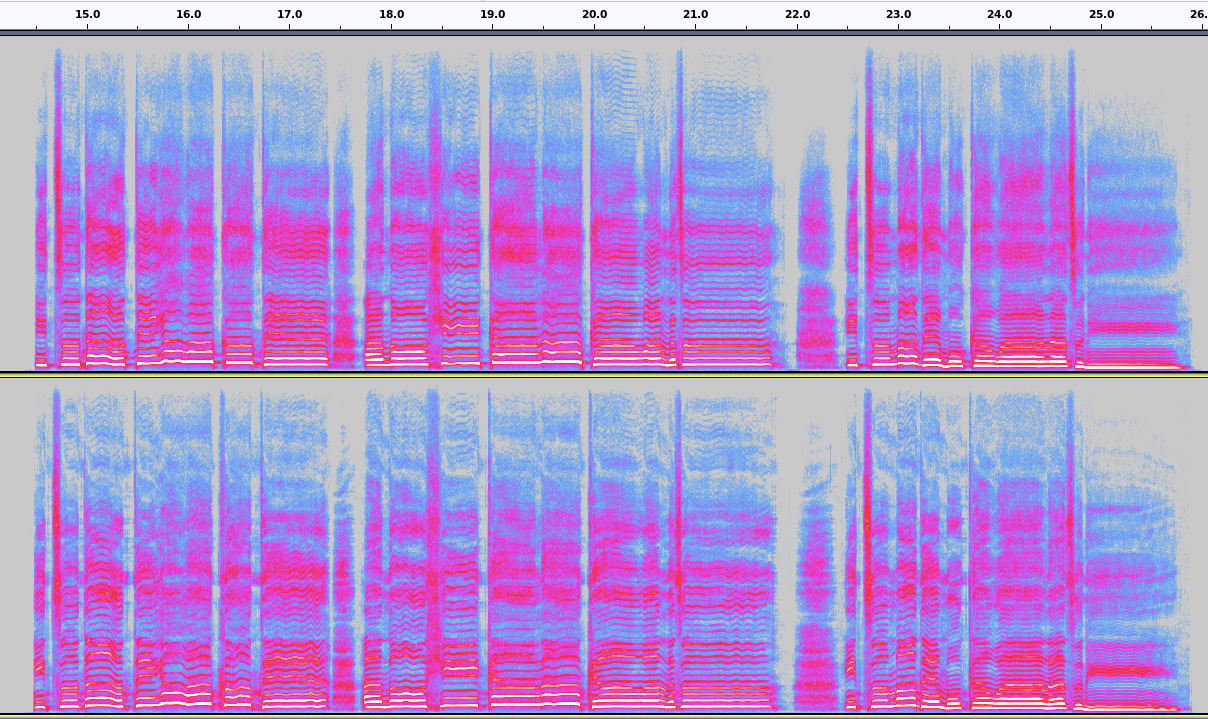

とのこと。このメッセージとともに、以下のようなスペクトルグラムの比較データが届いたのです。上が1.4.1のもので、下が1.5.0のもの。確かに比較すると違うのがハッキリと見て取れますが、Kanru Huaさんからは「今までのどうしてもAI音源が音が籠もる、スペクトルグラムがぼやける問題を、今回で完全に解決しました!」という勝利宣言のようなメッセージ来ていました。すごいな、と感心するばかりです。

前バージョン(上)と新バージョン(下)で歌わせた結果のスペクトルグラム比較

前バージョン(上)と新バージョン(下)で歌わせた結果のスペクトルグラム比較

Synthesizer V 1.5.0で多言語対応に対応。英語も普通に歌う

さて、今回のバージョンアップの目玉は、この人間的になったということよりも、多言語対応。ここについても少しふれておきましょう。先ほどの、oyasumiを英語データベースであるエレノア・フォルテ、そして中国語データベースである青溯(qingsu:チンスー)に歌わせてみました。ここでは有声音、無声音を分ける処理はしていませんが、自動ピッチ処理およびリバーブ処理は同じようにしています。

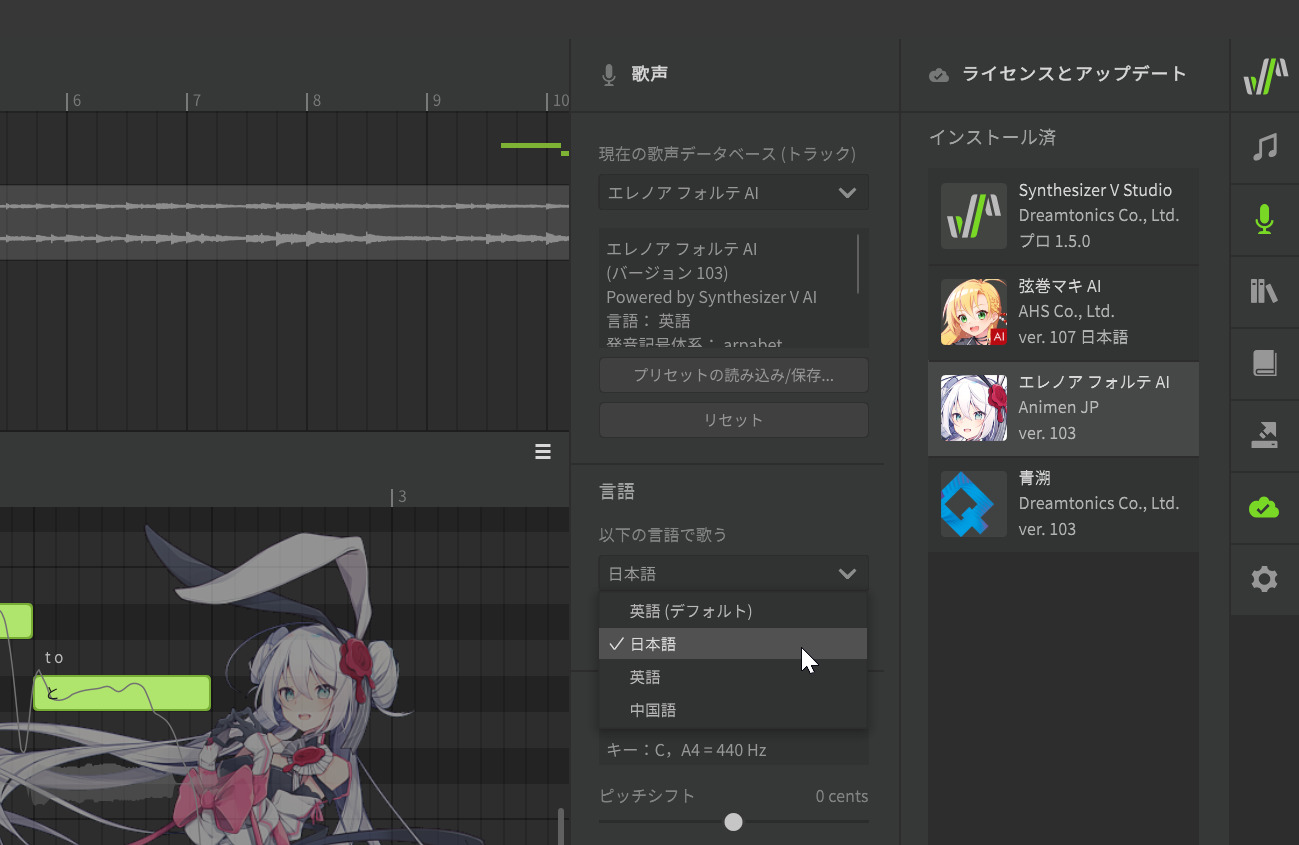

これなら問題ないレベルの表現力ですよね。これまでは英語データベースなら英語のみ、日本語データベースなら日本語のみ、中国語データベースも中国語のみと、その言語でしか歌わせることができませんでした。そのために、弦巻マキのように日本語データベース、英語データベースのバイリンガルのデータベースが存在していたわけですが、それがなくてもOKというわけです。使い方は簡単。単に、歌声設定画面での言語を「日本語」に設定すれば、本来は英語や中国語でしか歌わなかったデータベースでも日本語で歌うようになるし、反対に「英語」や「中国語」に設定すれば日本語のデータベースが英語や中国語で歌うようになるのです。

歌声設定画面の言語の設定をするだけで日本語、英語、中国語で歌うようになる

歌声設定画面の言語の設定をするだけで日本語、英語、中国語で歌うようになる

Synthesizer Vに限らず、VOCALOIDやCeVIOなどの歌声合成ソフトでも、日本語データベースで英語を歌わせる場合、これまで「空耳アワー」のような入力が求められていました。そう「誰が言ったか知らないが、言われてみれば確かに聞こえる」というような妙な日本語を入力して英語っぽく聴こえるようにする必要がありました。でも、このSynthesizer Vの1.5.0であれば、普通に英語で入力すれば英語で歌ってくれるのですから、ここでも歌声合成革命といえますよね。

ただ、先ほどのエレノア・フォルテの歌声や青溯の歌声を聴いてみて、「あれ?」と思った方も多いと思います。そう、キレイに日本語で歌ってはいるけれど、ちょっと外国人が歌っているニュアンスが抜け切れていないですよね。まさに外国人が日本語を歌った感じですが、これこそがAIによるディープラーニングによるもの。Kanru Huaさんに聞いたところ

完全に日本人の発音になると元のキャラクターと似てないと言われる可能性も考えて、微妙な発音やアクセントが残してあります。そこがちょうど良いバランスではないかと、考えました。ただ、エレノア・フォルテで日本語を歌わせると、母音のaは口の開き方が少し大きくなるとは思います。それは英語の発音のaと日本語の発音のaに違いがあるからです。ただ私が聴く限りでは完全な日本人発音のように感じますが、それは、私が外国人だからですかね?

と逆に質問されてしまいました。

おそらく、Kanru Huaさんの母国語が中国語だからなんでしょう。かなり昔のVOCALOIDでもスペイン語で歌った歌は、私にとっては人間の歌声としか思えなかったので、やはり母国語だとより微妙なニュアンスまで察知できるんだろうな、というのが私の持論です。

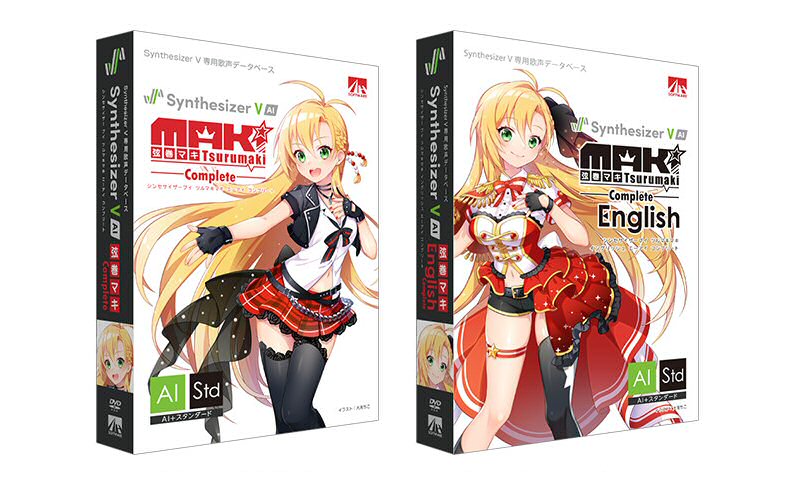

ちなみに、弦巻マキの場合、英語版があるので、「1.5.0の多国語対応で、英語版の存在意義がなくなるのでは?」と思う方もいると思います。が、先ほどの発音の違いからも分かるとおり、日本語版で英語発音させると、どうしてもジャパニーズイングリッシュになってしまうのに対し、英語版ならばしっかり英語として歌ってくれます。またキャラクタ性をしっかり保持した状態で歌わせあれるという意味でも、それぞれの言語に対応したデータベースの意義は大きくあるのです。その辺も考えた上で歌声データベース選びをするのもよさそうですね。

弦巻マキの場合、日本語版と英語版があるが、しっかりした英語を歌わせるにはやはり英語版が必要

ところで、もう一つ今回、Kanru Huaさんとメッセンジャーを使いながらチャットのようにやり取りした結果、よくわかったことが一つありました。これまでSynthesizer Vのエディターがバージョンアップするとエンジンが大きくバージョンアップするので、それによって歌声のレベルが進化していると思っていました。それも確かに事実なのですが、実際大きいのは歌声データベースの進化のほうが大きかったようなのです。

そう、Synthesizer Vのエディタのバージョンをアップデートすると、歌声データベースも新バージョンにアップデートできるケースが多く、たとえば弦巻マキ AIなどは、今回Ver.107にまでアップデートしています。古いバージョンでも使うことはできるのですが、そうするとクオリティーはほぼ昔のままの状態なんです。この点について、Kanru Huaさんに聞いてみると

とくにAI版の歌声の性能は歌声データベースのバージョンによって大きく変わってきます。ただ、最新版の歌声データベースは古いエディタでは使うことができません。これは新しいゲームを購入する時、ゲーム機本体もアップデートしないと遊べないのと同じようなものですね。

と解説してくれ、なるほど!と理解した次第です。

Synthesizer V 京町セイカが新たにリリース

さて、冒頭でも紹介した通り、今回のSynthesizer Vが1.5.0にアップデートしたタイミングで、京町セイカがリリースされています。ご存じの方も多いと思いますが、京町セイカは京都府精華町の広報キャラクターとして活躍しており、しゃべる音声合成ソフトであるVOICEROIDとして発売されて、広く使われてきました。その京町セイカの歌声創造プロジェクトというクラウドファンディングが行われ、それが成功した結果、今回のSynthesizer Vが生まれた、という背景があるのです。実際どんな歌声なのか、そのデモ曲が発表されているので、こちらをご覧ください。

これは基本的にはベタ打ちとのことですが、キレイな歌い方ですよね。実際のデータベースとしてはSynthesizer V 京町セイカ スタンダードと、Synthesizer V 京町セイカ AIがあり、それぞれ単体のダウンロード版が製品として販売されています。そしてその2つをセットにしたSynthesizer V 京町セイカ コンプリートというパッケージ、さらにはAHSユーザーが割安に購入できる、Synthesizer V 京町セイカ コンプリート AHSユーザー特別版の計4種類の製品となっています。

新たに発売されるSynthesizer V 京町セイカ コンプリートのパッケージ

新たに発売されるSynthesizer V 京町セイカ コンプリートのパッケージ

この京町セイカのほうは私もまだちゃんとテストできていないのですが、やはり自動ピッチ処理を行うことで、さらに人間へと昇華していくようなので、ぜひ試してみてください。

なお、すでにSynthesizer Vを購入して持っているという方は、誰でも無料で最新バージョンにアップデートできるので、ぜひ試してみてください。方法はいたって簡単です。画面右のアイコンをクリックして「ライセンスとアップデート」の設定画面を開きます。ここで「アップデートを確認」ボタンをクリックすれば、最新版があればそれが表示されるはず。あとは選択して「アップデート」ボタンをクリックすれば最新版になります。この際、エディターだけでなく歌声データベースのほうも一緒にバージョンアップさせるのが重要なポイント。なので、まずはエディター、続いて歌声データベースの順番で最新版にしてみてください。

「アップデートを確認」をクリック後、アップデートしたものを選び、「アップデート」ボタンを押せば完了

「アップデートを確認」をクリック後、アップデートしたものを選び、「アップデート」ボタンを押せば完了

以上、最新のSynthesizer Vについてレポートしてみましたが、いかがだったでしょうか?CeVIO AI、NEUTRINOなども含め、AI歌声合成はライバル同士が切磋琢磨しながら急速に進化している世界。これまでSynthesizer Vって、アニメキャラ的な歌声が多かっただけに、AIとはいえ、少し人工的な歌声だな……という印象を持っていましたが、設定次第でそこがまったく変わることを実感するとともに、そのすごさを思い知らされました。今後もまだ発展が続くようですが、この先どう進化していくのか、これ以上何かする必要があるのか…、期待しながら見守っていきたいと思います。

【関連情報】

Synthesizer Vシリーズ製品情報(AHS)

Dreamtonicsサイト

【価格チェック&購入】

◎Amazon ⇒ Synthesizer V 京町セイカ AI コンプリート

◎Amazon ⇒ Synthesizer V 弦巻マキ AI コンプリート

◎Amazon ⇒ Synthesizer V 弦巻マキ AI English コンプリート

◎Amazon ⇒ Synthesizer V 小春六花 AI コンプリート

◎Amazon ⇒ Synthesizer V Studio Pro スターターパック

◎Amazon ⇒ Synthesizer V Studio Pro ガイドブック付き

◎Amazon ⇒ 歌声合成ソフトウェア SynthesizerVユーザーズガイド

【関連記事】

なぜ中国の天才青年は日本で起業し、AI歌声合成ソフトをヒットさせたのか?Synthesizer Vの開発者、Kanru Huaさんインタビュー

Synthesizer Vが着実に進化中。最新アップデートで歌声がより滑らかに人間らしく。弦巻マキも日本語・英語で登場

Synthesizer VとCeVIO AIトークボイスの小春六花が発売開始。実際どんな声が出せるのか試してみた

AI歌声合成に対応したSynthesizer V AIがいよいよリリース。既存ユーザーは無料アップグレード可能。併せてAHSが各種新情報を一挙公開

まるで人のように歌うAI歌声合成の世界がさらに進化。Synthesizer VがAI対応し、従来型とハイブリッドで利用可能に。Sakiユーザーには期間限定無料配布

新世代歌声合成ソフトSynthesizer V Studio ProがアップデートしVST3/AUに対応

歌声合成はさらに次の時代へ。Synthesizer Vがサンプルベースと人工知能のハイブリッドで大きく進化

VOCALOIDの対抗馬、Synthesizer Vが無料で使えるWebブラウザ版を公開。2020年、歌声合成はさらに進化する

VOCALOIDの競合となるのか?中国人天才少年が開発した歌声合成ソフト、Synthesizer Vの破壊力

コメント

CeVIO AIと比較してどうなんでしょう?

Synthesizer VのApple シリコン ネイティブ対応はいつ頃でしょうか?

需要の問題かもしれないけど声優アーティストの声が好みではなくて…

普通の仮歌が欲しいアマチュアに必要な製品が存在しないのは寂しい限り